近年来,随着人工智能技术的飞速发展,深度学习领域中涌现出越来越多的大规模模型。这些模型不仅在参数量上实现了指数级增长,而且在应用场景上也展现出前所未有的潜力。然而,在众多模型中,究竟哪些模型的参数量更多?这种参数量差异背后又意味着什么?本文将从多个维度展开详细分析,帮助读者全面理解大模型参数量的对比情况。

模型类型的差异直接决定了其参数量的规模与分布方式。在当前主流的深度学习框架中,Transformer架构和卷积神经网络(CNN)是最常见的两种模型类型。它们各自具有独特的设计特点和适用场景,因此在参数量上的表现也存在显著区别。

Transformer架构自提出以来,便因其强大的序列建模能力而在自然语言处理(NLP)领域占据主导地位。该架构通过自注意力机制实现了高效的信息传递,从而大幅提升了模型的表达能力。

模型X1是一款基于Transformer架构的大型语言模型,其参数量达到了数十亿级别。该模型在训练过程中充分利用了大规模未标注语料库,通过无监督预训练积累了丰富的上下文知识。此外,其多头注意力机制允许模型同时关注多个关键位置,从而在复杂任务中表现出色。

与模型X1相比,模型Y1同样采用Transformer架构,但其设计更注重模块化和灵活性。通过引入动态路由机制,模型Y1能够根据输入数据的特点自动调整注意力权重,从而实现更高的适应性和泛化能力。尽管两者同属Transformer家族,但在具体参数分配和优化策略上仍存在明显差异。

CNN模型则广泛应用于计算机视觉领域,其核心在于利用局部连接性和共享权重来提取图像特征。尽管CNN在早期的图像分类任务中表现优异,但由于其固有的局限性,近年来逐渐被Transformer架构所取代。

模型X2是一款经典的卷积神经网络,其参数量相对较小,通常在几千万到数亿之间。该模型通过堆叠多个卷积层和池化层来逐步降低特征图的空间分辨率,最终生成紧凑的特征表示。尽管如此,模型X2依然能够在许多基础视觉任务中提供可靠的表现。

模型Y2是对传统CNN架构的一次重大改进,它通过引入残差连接和分组卷积技术显著提升了模型的容量和效率。相较于模型X2,模型Y2的参数量有所增加,但其计算成本并未显著上升,这使得它成为一种极具竞争力的解决方案。

除了模型类型之外,训练数据规模也是决定模型参数量的重要因素之一。训练数据的质量和数量直接影响模型的学习能力和泛化性能,而这一点在大规模模型中尤为突出。

预训练数据集的大小直接关系到模型的初始知识储备。在大规模预训练阶段,模型通过接触海量的文本或图像数据,逐步建立起丰富的特征映射空间。

数据集Z1是一个由互联网爬取的大型文本语料库,包含数百亿级别的样本。该数据集覆盖了各种主题和领域,为模型提供了极其多样化的训练素材。借助这样的数据集,模型可以在预训练阶段捕捉到更深层次的语言规律,从而提高下游任务的性能。

相比之下,数据集Z2虽然规模较小,但其质量却极高。该数据集经过精心筛选,仅包含高质量的专业文献和技术文档。虽然样本数量有限,但它所提供的专业信息使得模型在特定领域的任务中表现出色。

1、大模型参数量对比中,GPT-3和BERT哪个模型的参数更多?

在大模型参数量对比中,GPT-3的参数量远远超过BERT。具体来说,GPT-3的最大版本拥有1750亿个参数,而BERT-base只有约1.1亿个参数,BERT-large则有约3.4亿个参数。因此,在这两者之间,GPT-3的参数量明显更多,这使得GPT-3在处理复杂任务时表现更优,但也需要更高的计算资源。

2、为什么大模型参数量对比如此重要?

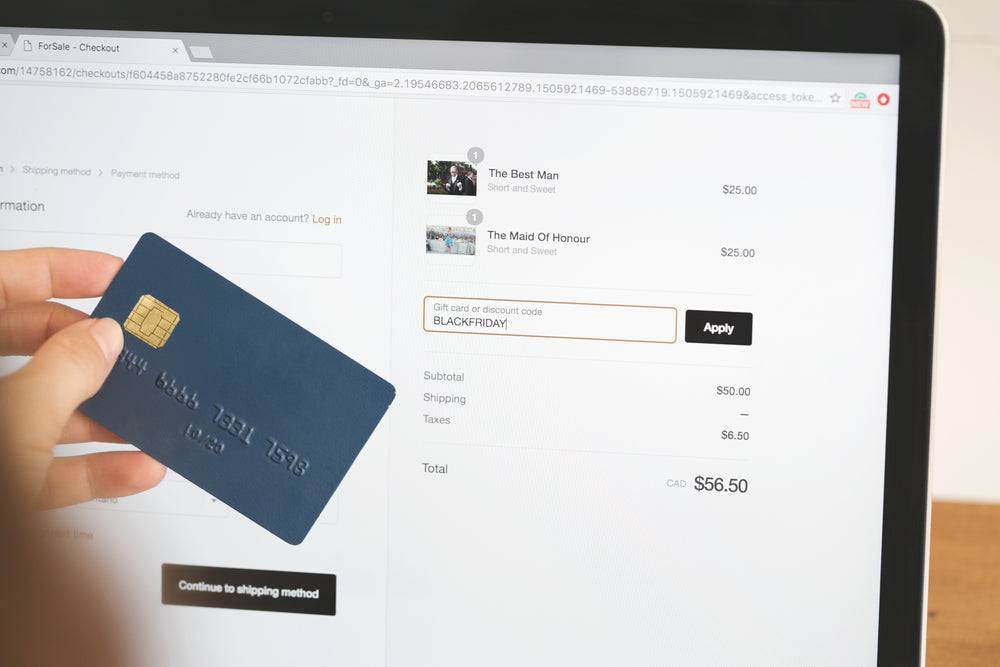

大模型参数量对比之所以重要,是因为参数量直接影响模型的能力和性能。通常情况下,更多的参数意味着模型可以学习到更复杂的模式,并在自然语言生成、翻译等任务上表现出更强的能力。然而,高参数量也带来了训练成本高、推理速度慢等问题,因此在实际应用中需要权衡参数量与效率之间的关系。

3、大模型参数量对比中,哪些模型是目前参数量最大的?

截至2023年,参数量最大的模型包括阿里巴巴的通义千问(Qwen)系列、谷歌的Gemini、以及Meta的Llama系列等。其中,通义千问系列中的某些闭源版本参数量已超过万亿级别,而其他厂商的模型也在不断突破参数量上限。这些超大规模模型在多模态任务、复杂推理等方面展现出了卓越的能力。

4、在大模型参数量对比时,除了参数量外还需要关注哪些指标?

在进行大模型参数量对比时,除了参数量本身,还需要关注模型的效率(如推理速度、能耗)、泛化能力(是否能在不同领域表现良好)、数据需求(训练所需的数据规模)以及应用场景适配性(是否适合特定任务)。例如,某些小参数量模型通过优化架构或蒸馏技术,可能在特定任务上表现优于大参数量模型。因此,参数量只是评估模型的一个维度,而非唯一标准。

一、概述:aigc是大模型吗?揭秘生成式人工智能的技术本质 AIGC(Artificial Intelligence Generated Content)是一种基于人工智能生成内容的技术,近年来随着技术的发展逐

...

概述:大模型安全检测是否能够有效防范潜在风险? 随着人工智能技术的飞速发展,大模型在各行各业中扮演着越来越重要的角色。然而,随之而来的安全问题也引起了广泛关注。

...

一、大模型产品的全面解析 1.1 大模型产品的定义与背景 1.1.1 什么是大模型产品 大模型产品是一种基于大规模参数的机器学习模型所构建的应用程序或工具,其主要目的是通过

...

发表评论

评论列表

暂时没有评论,有什么想聊的?